互联网数据服务的核心 数据处理方法与实践

在当今数字化时代,互联网数据服务已成为驱动商业决策、优化用户体验和推动技术创新的关键力量。其核心在于高效、准确的数据处理方法,这些方法不仅决定了数据的价值密度,也直接影响到服务的可靠性与洞察深度。

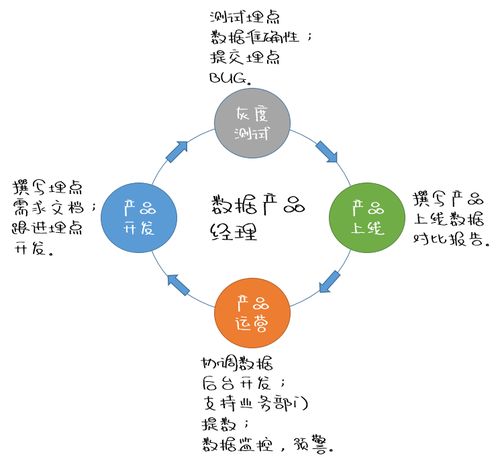

一、数据处理的基本流程

互联网数据服务通常遵循一套标准化的数据处理流程,涵盖从原始数据到可用知识的完整链路。首先是数据采集,通过爬虫、API接口、日志记录等方式从网站、应用、传感器等源头获取海量原始数据,这些数据往往是非结构化的。紧接着是数据清洗与预处理,此阶段旨在消除噪声、纠正错误、处理缺失值,并将数据转换为一致的格式,为后续分析奠定坚实基础。

二、核心处理方法与技术

- 批处理与流处理:根据时效性需求,数据处理可分为批处理与流处理。批处理适用于对历史数据的离线分析,如使用Hadoop、Spark等框架进行大规模计算;而流处理则针对实时数据,通过Kafka、Flink等工具实现即时分析与响应,满足监控、推荐等场景需求。

- 数据存储与管理:针对不同类型的数据,存储方案需灵活选择。结构化数据常存入关系型数据库(如MySQL、PostgreSQL),半结构化和非结构化数据则可利用NoSQL数据库(如MongoDB)或分布式文件系统(如HDFS)。数据仓库与数据湖的构建,进一步支持了复杂查询与长期分析。

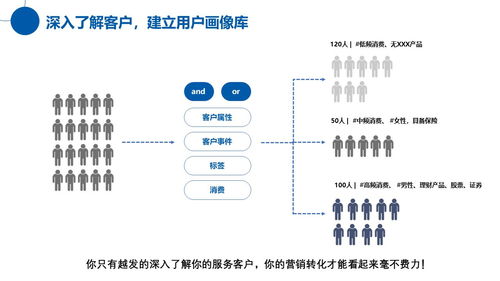

- 数据分析与挖掘:这是提取价值的关键环节。借助统计分析、机器学习及人工智能技术,企业可以从数据中识别模式、预测趋势。例如,通过聚类分析用户行为,或利用自然语言处理解析社交媒体情感。数据可视化工具(如Tableau、Power BI)则帮助将分析结果直观呈现,辅助决策。

三、挑战与未来趋势

尽管数据处理方法不断进步,互联网数据服务仍面临诸多挑战:数据隐私与安全(需遵循GDPR等法规)、数据质量保障、以及处理速度与规模的平衡。边缘计算将数据处理推向更接近数据源的终端,以降低延迟;而人工智能的深度融合,正推动自动化数据管道与智能分析成为主流,使互联网数据服务更加精准、高效。

数据处理方法是互联网数据服务的引擎,其优化与创新直接决定了服务的竞争力。企业需持续关注技术演进,结合业务需求,构建灵活、可靠的数据处理体系,从而在数据洪流中挖掘真金,赋能可持续发展。

如若转载,请注明出处:http://www.yinseshow.com/product/74.html

更新时间:2026-04-12 04:07:19